从零实现 AI Coding Agent

从 LLM API 调用到 Agent Loop,构建一个能读代码、改文件、跑命令的终端 AI 编程助手。涵盖 Tool Use 协议、流式响应、上下文管理、CLI 交互等核心主题。

课程简介

Claude Code、Codex、Windsurf -- AI 编程工具正在重塑开发者的工作方式。但它们内部是怎么工作的? 为什么 Agent 能读你的代码、修改文件、运行命令?

本课程带你从零构建一个完整的终端 AI 编程助手 -- 类似 Claude Code 的核心引擎。 从第一个 LLM API 调用开始,逐步实现流式响应、Tool Use 协议、文件读写工具、Agent Loop 核心循环、 上下文管理与压缩、CLI 交互界面,最终构建出一个能读代码、改文件、跑命令、自主规划任务的 Coding Agent。

更新进度

20 / 20 章已全部更新已完结

学完这门课,你将掌握

理解 AI Agent 的核心架构 -- 感知、推理、行动循环,以及 Coding Agent 的特殊设计

掌握 Tool Use 协议的完整实现 -- JSON Schema 定义工具、解析 tool_use、构造 tool_result

能独立实现 Read / Write / Bash / Search 等开发者工具,理解文件沙箱和安全防护

深入理解上下文工程 -- Token 预算分配、对话压缩策略、避免上下文污染和幻觉循环

掌握 System Prompt 的分层设计方法论,学会写出高质量的 Agent 指令

具备从零构建 AI 应用的完整能力,不再只是调 API 的"搬运工"

适合谁学习

想做 AI 产品的开发者

不满足于调 API,想理解 Agent 的核心架构,具备从零构建 AI 应用的能力

对 AI 编程工具好奇的人

每天用 Claude Code / Codex,想知道这些工具内部是怎么工作的

想转型 AI 方向的工程师

有编程基础,想快速掌握 LLM 应用开发的核心技能栈

前置知识

熟悉 TypeScript 或 Python 中的任意一门即可。你不需要有 AI/ML 背景 -- 课程从 LLM API 的基本调用讲起,不涉及模型训练或微调,专注于应用层的工程实现。

你将构建什么

LLM 对话引擎

流式响应 + 多轮对话 + 多模型适配

工具系统

Read / Write / Bash / Grep / Glob

Agent Loop

感知 → 推理 → 行动 → 反馈循环

CLI 界面

REPL + Markdown 渲染 + Spinner

架构概览

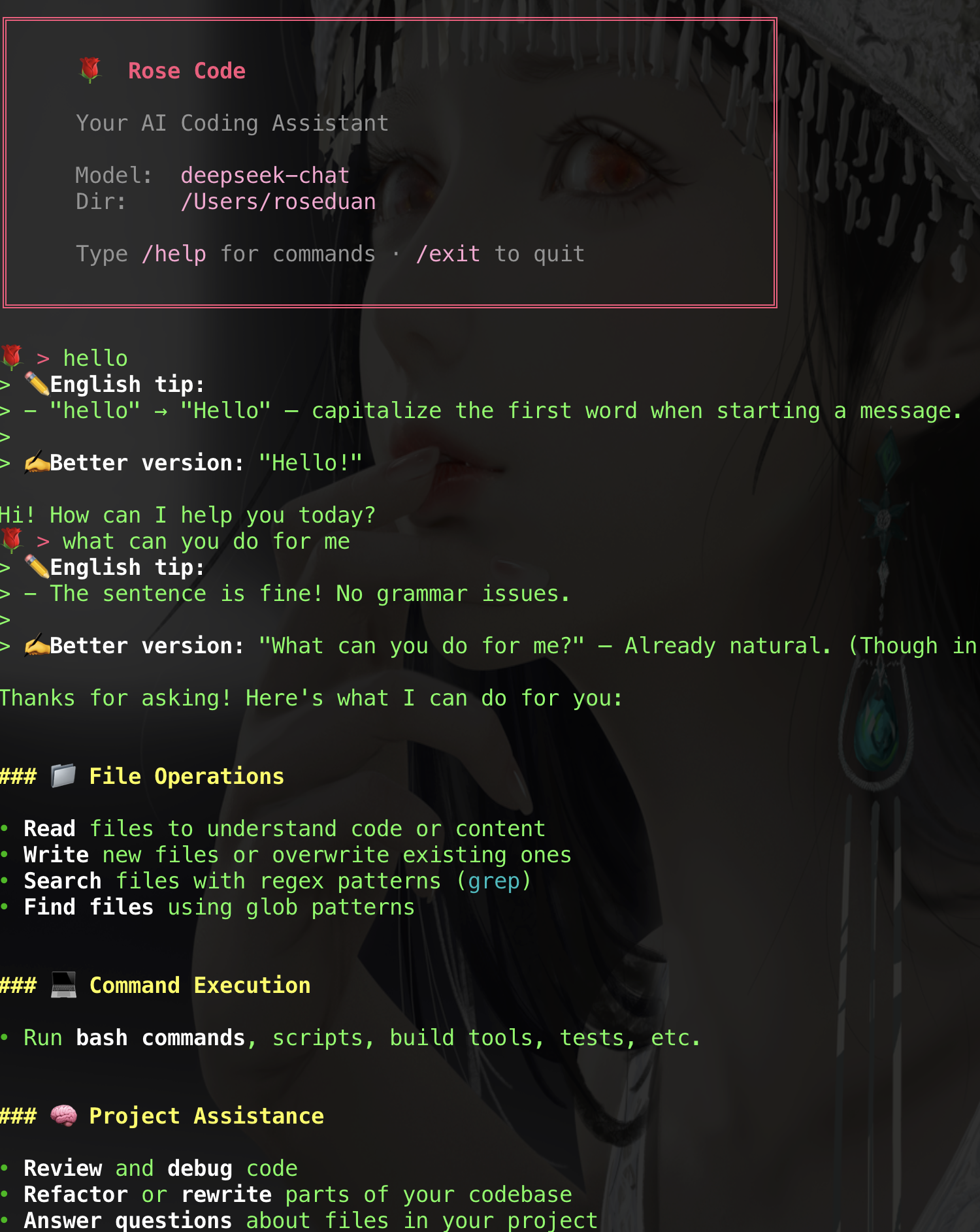

实际运行效果

课程最终构建出的 AI Coding Agent 终端运行截图

涉及的核心技术概念

LLM API 调用

Server-Sent Events 流式响应

Tool Use 协议

JSON Schema 工具定义

Agent Loop 循环

并行工具调用

任务规划与分解

System Prompt 分层设计

Token 计数与预算

对话历史压缩

Prompt Injection 防护

文件沙箱安全

Markdown 终端渲染

子进程管理

学员评价

课程数据

20章节

2编程语言

3,000+行代码 / 每种语言

3免费章节